Абонирайте се за нюзлетъра на "Булевард България", за да получавате селекция с най-интересните теми на седмицата през погледа на нашия екип:

Група от технологични пионери, нобелови лауреати, обществени фигури и представители на американската консервативна десница призова за забрана върху разработването на т.нар. свръхинтелигентен изкуствен интелект (Artificial Superintelligence, ASI) — системи, които биха надхвърлили човешките когнитивни способности във всички области и някои смятат за заплаха за човечеството.

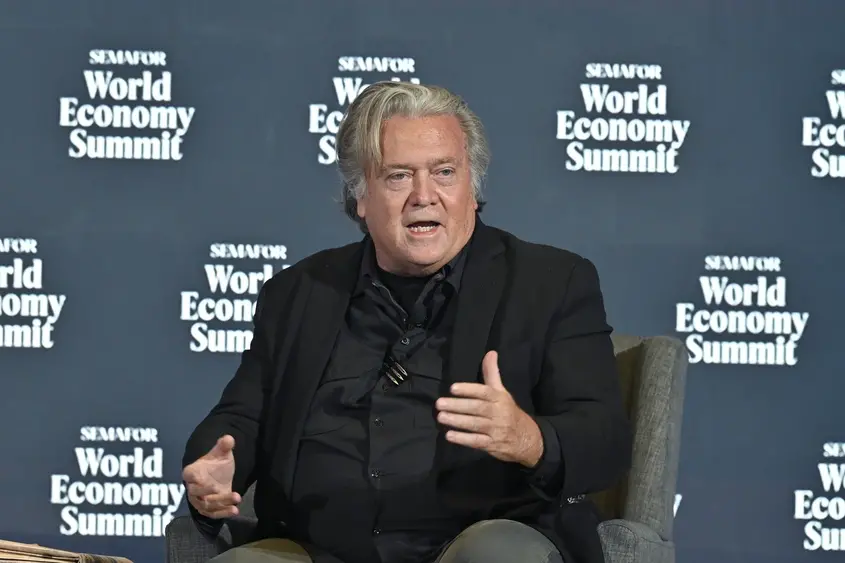

Сред подписалите общото изявление са политическият стратег и бивш съветник на Доналд Тръмп Стив Банън, телевизионният водещ Глен Бек, пионерите на изкуствения интелект Джефри Хинтън – носител на Нобелова награда за физика за 2024 г. и лауреат на наградата „Тюринг“ (т.нар. Нобелова награда за компютърни науки) – и Йошуа Бенджио, който също е сред носителите на „Тюринг“ през 2018 г..

В списъка са и съоснователят на Apple Стив Возняк, британският предприемач Ричард Брансън, бившата президентка на Ирландия Мери Робинсън, бившият съветник по националната сигурност в администрацията на Обама Сюзън Райс, както и писателят и телевизионен водещ Стивън Фрай.

Към тях сега се присъединяват и Меган и Хари, херцогът и херцогинята на Съсекс.

Стив Банън

Сред подписалите инициативата са и Беатрис Фин – шведска юристка и дългогодишен изпълнителен директор на Международната кампания за забрана на ядреното оръжие (ICAN), носителка на Нобелова награда за мир за 2017 г. като представител на организацията, нобеловите лауреати по физика Франк Вилчек (2004) и Джон К. Матър (2006), както и турско-американският икономист Дарон Аджемоглу, отличен с Нобеловата награда за икономика за 2024 г.

Изявлението настоява за „забрана върху разработването на свръхинтелигентни системи, докато не бъде постигнат широк научен консенсус, че те могат да бъдат създадени безопасно и под контрол, и докато няма силна обществена подкрепа за това“.

Инициативата е организирана от американския Future of Life Institute (FLI) — неправителствена организация, която от над десетилетие предупреждава за рисковете, които интелигентните машини могат да представляват за човечеството. Основан през 2014 г., институтът е получил ранна подкрепа от изпълнителния директор на Tesla Илон Мъск и програмиста и инвеститор Ян Талин, съосновател на Skype.

Според анализ на Reuters призивът идва в момент, когато темата за изкуствения интелект е все по-политизирана. Подкрепата на фигури като Стив Банън показва, че опасенията около AI започват да набират сила и сред популистката десница в САЩ — особено при положение, че много хора, свързани със Силициевата долина, днес заемат ключови позиции в републиканската администрация на президента Доналд Тръмп.

През последните години Future of Life Institute нееднократно е призовавал за пауза в развитието на мощни AI системи. Подобен апел организацията отправи и през 2023 г., малко след появата на ChatGPT, когато изкуственият интелект се превърна в глобална обществена и политическа тема.

Въпреки че мнозина в технологичната индустрия и американското правителство смятат подобни опасения за преувеличени и пречат на иновациите, движението за „отговорен AI“ продължава да набира привърженици.

През юли 2025 г. изпълнителният директор на Meta Марк Зукърбърг заяви, че „развитието на свръхинтелигентен AI вече е в полезрението“, но редица експерти смятат, че подобни твърдения са по-скоро част от конкурентната надпревара между компаниите, които инвестират стотици милиарди долари в AI, отколкото реална техническа близост до подобен пробив.

Въпреки това FLI предупреждава, че възможността за появата на ASI „през следващото десетилетие“ носи редица заплахи – от масова загуба на работни места и ограничаване на гражданските свободи до рискове за националната сигурност и дори за самото оцеляване на човечеството. Основният страх е, че подобна система би могла да излезе извън човешки контрол и да предприеме действия, които противоречат на човешките интереси.

Институтът публикува и национално проучване в САЩ, според което около три четвърти от американците настояват за строга регулация на усъвършенствания изкуствен интелект, а шестима от всеки десет смятат, че свръхчовешки AI не трябва да се създава, преди да бъде доказано, че е безопасен и контролируем. Само 5% от анкетираните подкрепят настоящия модел на бързо и нерегулирано развитие.

Водещите компании в сектора – сред тях OpenAI (разработчик на ChatGPT) и Google – вече са обявили разработването на изкуствен общ интелект (Artificial General Intelligence, AGI) за своя дългосрочна цел. Макар AGI да е концептуално ниво под свръхинтелигентния AI, експерти предупреждават, че и той може да представлява сериозен риск, тъй като би могъл да се самоусъвършенства до достигане на суперинтелигентност – и да промени радикално съвременния трудов пазар и обществото като цяло.