Абонирайте се за нюзлетъра на "Булевард България", за да получавате селекция с най-интересните теми на седмицата през погледа на нашия екип:

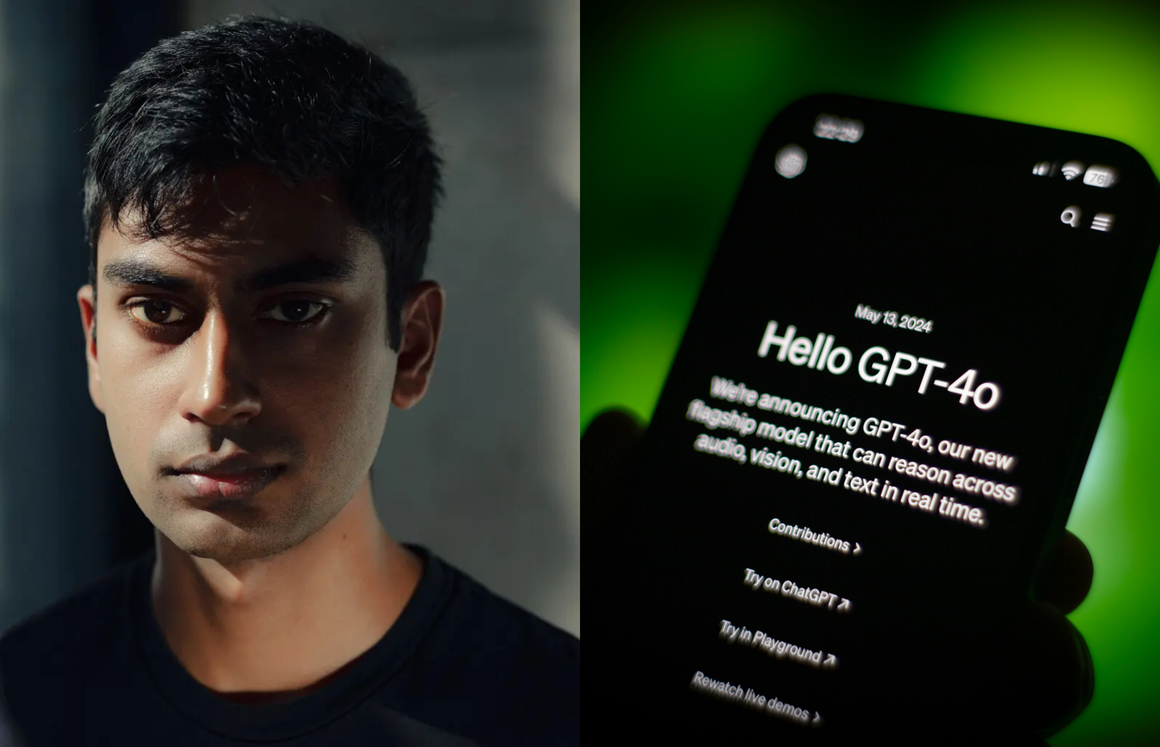

26-годишен бивш изследовател от OpenAI и отявлен критик на проблемите около генеративния AI е намерен мъртъв в дома си в Сан Франциско.

Сучир Балажи е работил за създателите на ChatGPT само до преди няколко месеца, но напуска, разочарован от развитието на технологията.

Само преди 2 месеца той дава интервю в New York Times, в което говори открито срещу използването на съдържание със защитени авторски права за трениране на изкуствен интелект.

Според местните служби - Балажи сам е посегнал на живота си, мотивите за самоубийството му не са известни.

В последното си интервю той споделя, че планира да работи по "лични проекти".

Роден и израснал в Купертино, Калифорния, Сучир Балажи започва да се занимава с изкуствен интелект още като тийнейджър.

Причината за интереса му са постиженията на DeepMind – компанията, чиито AI модели можеха да играят сложни игри като Go и която беше придобита от Google през 2014 г.

Тогава той възприема AI като средство, което може да помогне са решаването на нерешими проблеми като лечението на тежки болести или спирането на стареенето.

Балажи завършва Калифорнийския университет в Бъркли и заедно със свои състуденти се присъединява към OpenAI през 2020 г. Младият мъж работи по събирането на огромни масиви интернет данни за трениране на езиковия модел GPT-4.

Отначало той и колегите му възприемат проектите като изцяло научни. Но след пускането на ChatGPT през 2022 г. стана глобален феномен и финансов удар, Сучир Балажи започва да променя изцяло разбирането си за етичните и комерсиалните последствия от работата си.

През август 2024 г. той напуска компанията.

Тогава той започва да публикува и статии, в които предупреждава за опасността от злоупотребата при тренирането на AI системи.

Проблемът е в разбирането на големите компании за това къде са границите на т.нар. "fair use" (разрешена/честна употреба) - изключението, при което книги, статии, илюстрации, снимки и друга интелектуална собствност с авторски права може да се ползва свободно.

Изискването е новото съдържание да съществено променено от оригиналния си вид и да не се конкурира на същия пазар с директно копие.

Според него, генеративните AI модели като ChatGPT правят точни копия на данните, върху които са тренирани - нещо, което нарушава базово изискване за справедлива употреба.

Балажи твърди, че дори преработената информация от езиковия модел да не повтаря оригинала дума по дума, тя не е фундаментално нова творба. В същото време - моделът вече работи като търговски конкурент на защитената информация, върху която се е тренирал.

Още по-мащабният проблем с AI технологиите са халюцинациите - създаването на фалшиви или напълно измислени данни.

Според него това потенциално застрашава съществуването на творчески професии, а халюцинациите допринасят за ерозията на качественото съдържание онлайн, смята още той.

"Ако човек вярва в това, в което аз вярвам, просто трябва да напусне компанията", казва Балажи в интервюто си за NYT. "Това не е устойчив модел за интернет екосистемата като цяло".

Притесненията на Балажи са споделени от други лидери в индустрията, а някои големи медии като New York Times водят дело срещу OpenAI заради злоупотребата с тяхно съдържание.