Абонирайте се за нюзлетъра на "Булевард България", за да получавате селекция с най-интересните теми на седмицата през погледа на нашия екип:

Реалност или илюзия? Истина или лъжа? Навлязохме в ера, в която всеки човек може да бъде представен да казва абсолютно всичко, във всеки един момент, дори когато никога не е говорил за съответните неща. А повечето хора са свикнали да вярват на всичко видяно и чуто.

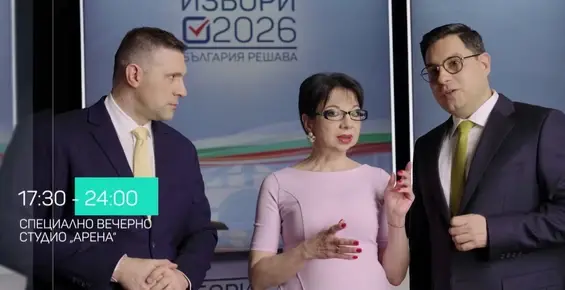

Запознайте се с феномена дийпфейк - начинът, по който, чрез използване на изкуствен интелект, може да "накарате" политик да отправи обиди към своята опозиция, да измислите фалшива новина и да я представите с гласа на водещ по националната телевизия или да промените резултата на финала на световното първенство по футбол. И да накарате хората да вярват, без дори да осъзнават, че са заблуждавани.

Навлязохме в ера, в която този нов феномен може да се окаже опасно оръжие в дискредитиране на политици, в преобръщане на норми в цели общества и в подкопаване на националната сигурност.

Най-скорошният пример за дийпфейк, който предизвика оживени дебати, е свързан с Илън Мъск. Основателят на SpaceX бе представен как пее руската песен "Земля в иллюминаторе" - превърнала се в химн на космонавтиката в страната. Това се случва точно в навечерието на мисията Demo-2, в която

Успех за Demo-2: Crew Dragon се скачи с Международната космическа станция

От 2011 НАСА не бе изстрелвала астронавти в орбита и единственият път към Космоса бе руският кораб Soyuz.

Във видеото съвсем ясно си проличава, че не Илън Мъск пее песента за космически изследователи. Лицето му е поставено вместо това на вокала на рок групата от Санкт Петербург "Земляне".

Миналия месец, по време на хитовата документална поредица на ESPN “Последният танц” (The Last Dance), State Farm представиха ТВ реклама, която се превърна в една от най-обсъжданите в последно време. Изглеждаше сякаш тя показва кадри от 1998 на анализатор от ESPN, правещ шокиращо точни прогнози за 2020 г.

Както се оказва, клипът не е бил истински: той е бил генериран чрез свръхмодерен изкуствен интелект. Рекламата предизвика изненада, забавление и радост сред зрителите.

Това обаче, което те би трябвало да изпитват, е дълбока загриженост.

Рекламата на State Farm беше безобиден пример за важен и опасен нов феномен в изкуствения интелект: дийпфейковете. Дийпфейк технологията позволява на всички, разполагащи с компютър и интернет връзка, да създават реалистично изглеждащи снимки и видеа на хора, казващи и правещи неща, които всъщност не са споменавали и извършвали.

Съчетаващи фразите “дълбоко учене” (“deep learning”) и “фалшив” (“fake”), дийпфейковете за първи път се появиха в Интернет в края на 2017 г., като бяха базирани на иновативен нов метод за “дълбоко учене”, известен като генеративни конкурентни мрежи (GAN).

Няколко дийпфейк видеа нашумяха напоследък, давайки на милиони хора по света първа представа за тази нова технология: видео на Барак Обама, използващ нецензурна фраза по адрес на Доналд Тръмп, видео на Марк Зукърбърг, “признаващ”, че реалната цел на Facebook е да манипулира и използва потребителите си, клип на Бил Хейдър, в който той се преобразява в Ал Пачино във вечерно токшоу.

Количеството дийпфейк съдържание онлайн се разраства с бързи темпове. В началото на 2019 е имало 7964 дийпфейк видеа онлайн, гласи доклад от стартъпа Deeptrace; само девет месеца по-късно, броят им се е увеличил до 14 678. Несъмнено те са продължили да се увеличават и след това.

Въпреки че е впечатляваща, сегашната дийпфейк техология все още не е на нивото на оригиналното видео - при по-близък поглед обикновено е възможно да определите, че видеото е дийпфейк. Технологията обаче се подобрява с поразителни темпове. Експерти предричат, че скоро дийпфейковете ще са неразличими от реалните кадри.

“През януари 2019 дийпфейковете бяха пълни с бъгове и неясни като образ,” казва Хани Фарид, професор от университета в Бъркли и експерт по дийпфейковете. “Девет месеца по-късно не съм виждал нищо подобно на начина, по който се развиват. Това е върхът на айсберга".

В момента се намираме в повратен момент. В следващите месеци и години съществува риск дийпфейковете да прераснат от интернет куриоз в крайно деструктивен политически и социален фактор. Обществото трябва да действа още сега, за да се подготви за това.

Да виждаш нещо, не означава да му вярваш

Първата област, в която масово се използваше дийпфейк технологията - както често става с новите технологии - е порнографията. Към септември 2019 г. 96% от дийпфейк видеата онлайн бяха порнографски, констатира докладът на Deeptrace.

Появиха се няколко уеб сайтове, посветени конкретно на дийпфейк порнографията, като колективно привлякоха стотици милиони посетители в последните две години. Дийпфейк порнографията почти винаги се случва без съгласието на замесените страни, като е свързана с изкуствен синтез на нецензурни видеа с участието на прочути знаменитости или лични познати.

От тези тъмни кътчета на интернет употребата на дийпфейкове започна да се разпространява в политическата сфера, където потенциалът за причиняване на хаос е още по-голям.

Не е нужно особено богато въображение, за да осмислите мащабите на щетите, които могат да бъдат нанесени, ако на населението на цели държави може да бъдат показани фалшифицирани видеа, за които хората да вярват, че са истински. Представете си дийпфейк кадри на политик, в които се показва как той дава или взема подкуп, или извършва сексуално посегателство точно в навечерието на избори; или на американски войници, извършващи зверства срещу цивилни в други държави; или на Доналд Тръмп, обявяващ нанасянето на ядрен удар срещу Северна Корея.

В свят, където съществува дори малка несигурност дали такива клипове са реални, последиците могат да бъдат катастрофални.

Заради масовото разпространение на технологията, подобни кадри могат да бъдат създадени от всеки: организирани на държавно равнище сили, политически групи или отделни хора.

В един от последните си доклади институтът “Брукингс” мрачно обобщи диапазона от политически и социални опасности, които представляват дийпфейковете: “изкривяване на демократичния дискурс; манипулиране на избори; подкопаване на доверието в институциите; отслабване на журналистиката; задълбочаване на социални разделения; подкопаване на обществената безопасност; нанасяне на трудно преодолими щети върху репутацията на видни личности, включително политици на избираеми постове и кандидати за такива постове".

Като се вземат предвид рисковете, американските законодатели започнаха да обръщат внимание на този въпрос.

“В миналото, ако искахте да застрашите САЩ, ви бяха нужни 10 самолетоносача, ядрено оръжие и ракети с голям обхват,” заяви наскоро американският сенатор Марко Рубио. “Сега... единственото, което ви е необходимо, е възможността да създадете много реалистично фалшиво видео, което да може да подкопае изборите, да хвърли страната ни във вътрешна катастрофална криза и дълбоко да ни отслаби".

Експертите са съгласни с това твърдение. По думите на Хани Фарид, един от водещите световни експерти по дийпфейковете: “Ако не можем да вярваме на видеозаписите, на аудиозаписите, на кадрите, на информацията, която получаваме от различни точки по света, това е сериозен риск за националната сигурност".

И този риск вече не е чисто хипотетичен - има ранни примери на дийпфейкове, влияещи върху политиката в реалния живот. Експерти предупреждават, че тези инциденти са ясен показател за това колко сериозен е проблемът.

Миналия месец политическа група в Белгия публикува дийпфейк видео на белгийския премиер Софи Вилмес, изнасяща реч, в която свързва епидемията от COVID-19 с щетите върху околната среда, и призоваващ за драстични действия за борба с климатичните промени. Поне част от зрителите вярваха, че речта е била реална.

Още по-коварен аспект на дийпфейковете е, че дори самата възможност някое видео да бъде дийпфейк може да предизвика объркване и да улесни политически заблуди, независимо дали реално е била използвана дийпфейк технология. Най-драстичният пример за това идва от Габон - малка държава в централна Африка.

В края на 2018 г., президентът на Габон Али Бонго не се появявал от месеци на обществени места. Носели се слухове, че той вече не е в достатъчно добро здраве, за да заема поста си, или дори че е починал. В опит да разсее тези опасения и да затвърди лидерството на Бонго над страната, администрацията му обявила, че той ще направи национално телевизионно обръщение на Нова година.

Във видео обръщението (което си заслужава да гледате сами), Бонго изглежда скован и неестествен, с изкуствен маниер на говорене и различно движение на части от лицето си. Видеото веднага породи подозрения, че правителството крие нещо от обществото. Политическите опоненти на Бонго заявиха, че кардите са дийпфейк и президентът е недееспособен или мъртъв. Слуховете за дийпфейк заговор се разпространиха бързо в социалните мрежи.

Политическата ситуация в Габон бързо се дестабилизира. В рамките на седмица военните организираха преврат - първият в страната от 1964 г. насам - като се позоваха на новогодишното обръщение като доказателство, че нещо не е наред с президента.

И до този момент експертите не могат да определят със сигурност дали новогодишното обръщение е било истинско, въпреки че повечето вярват, че е това е така. (Опитът за преврат се оказа неуспешен; Бонго впоследствие се появи на обществени места и остава на поста и до този момент).

Но дали видеото е било истинско е почти техническа подробност. По-важната поука е, че появата на дийпфейкове прави все по-трудно за обществото да прави разграничение между истина и фалшификат, ситуация, която неизбежно ще се използва от политически фигури - с потенциално катастрофални последици.

“Хората вече използват факта, че дийфейковете съществуват, за да дискредитират реални видео доказателства,” казва професорът от Южнокалифорнийския университет Хао Ли. “Въпреки че има кадри, показващи как правите или казвате нещо, можете да заявите, че те са били дийпфейк, и противоположното е много трудно за доказване.”

В два скорошни инцидента политици в Малайзия и в Бразилия се опитаха да избегнат последиците от компрометиращи видеозаписи, като твърдяха, че видеата са дийпфейкове. И в двата случая никой не успя категорично да докаже, че не са - и общественото мнение остана разделено.

Ученият Авив Овадия предупреждава за това, което тя нарича “апатия към реалността”: “Изискват се твърде много усилия, за да се прецени какво е реално и какво не, така че сте по-склонни просто да приемете това, което отговаря на предишните ви убеждения и пристрастия".

В свят, в който да виждате нещо не означава непременно да вярвате на видяното, способността големи общности да постигнат съгласие какво е истина - или да се ангажират в конструктивен дебат за нея - изведнъж изглежда несигурна.

Пътят напред

Какви законодателни, политически и социални стъпки можем да предприемем, за да се защитим от опасностите на дийпфейковете?

Едно изкусително просто решение е да бъдат гласувани закони, които обявяват за незаконно създаването и разпространението на дийпфейкове. Щатът Калифорния експериментира с този подход, като миналата година там влезе в сила закон, който прави незаконно създаването или разпространението на дийпфейкове на политици в период от 60 дни преди избори. Но евентуална тотална забрана на дийпфейкове би била изправена и пред конституционни, и пред практически препятствия.

Първата поправка на Конституцията на САЩ гарантира свободата на словото. Всеки закон, забраняващ съдържание онлайн, особено политическо съдържание, има риск да е в противоречие с тези конституционни защити.

“Политическото слово се радва на най-високо ниво на защита според американското законодателство,” казва професорът по право Джейн Къртли. “Желанието да бъдат защитени хората от подвеждащо съдържание в навечерието на избори е много силен и разбираем аргумент, но съм скептична за това дали властите ще могат да налагат спазването на закона в Калифорния.”

Извън конституционните опасения забраната на дийпфейковете вероятно ще се окаже непрактична за прилагане заради анонимността и липсата на граници в Интернет.

Други съществуващи правни рамки, които могат да бъдат приложени в борбата с дийпфейковете, включват защитата на авторското право, защитата срещу клевета и правото на публичност. Но като се има предвид широкото прилагане на доктрината за справедлива употреба, полезността на тези правни механизми може да се окаже ограничена.

В краткосрочен план най-ефективното решнеие може да дойде от големи технологични платформи като Facebook, Google и Twitter, доброволно предприемащи по-усърдни действия за ограничаване на разпространението на вредни дийпфейк видеа.

Разчитането на частни компании да решават мащабни общи политически и социални проблеми, разбираемо, предизвиква дълбоко безпокойство у мнозина. И все пак, както констатират правистите Боби Чесни и Даниел Сайтрон, условията за употреба на тези технологични платформи са “най-важните документи, регулиращи свободата на словото в дигиталното пространство в съвременния свят”. В резултат на това политиките за съдържание на тези компании може би са “най-очевидният механизъм за реакция” срещу дийпфейковете.

Свързана законодателна алтернатива е промяна в спорния член 230 на американския Закон за благоприличие на комуникациите. Писан в ранните дни на комерсиалния Интернет, член 230 дава на интернет компаниите почти пълен граждански имунитет срещу всякакво съдържание, публикувано в техните платформи от трети страни. Отмяната на тези защити би направила компании като Facebook съдебно отговорни за ограничаване на разпространението на вредно съдържание в техните сайтове. Подобен подход обаче води до комплексни опасения за свободата на словото и цензурата.

В крайна сметка, няма да е достатъчно едно-единствено решение. Необходима първа стъпка е да се увеличи информираността на обществото за възможностите и рисковете от дийпфейковете. Информираното гражданско общество е критична защита срещу масово разпространение на дезинформация.

Възходът на фалшивите новини напоследък доведе до опасения, че навлизаме в свят на “пост-истината”. Дийпфейковете заплашват да засилят и ускорят тази траектория. Следващата голяма стъпка в тази драма предстои много скоро: изборите през 2020 г. Залозите надали биха могли да бъдат по-високи.

“Човекът, застанал пред танка на площад “Тиенанмън”, трогна света", казва професорът от Нюйоркския университет Насир Мемон. “Телефонните разговори на Никсън му струваха президентския пост. Кадрите на ужасите в концлагерите най-накрая ни накараха да предприемем действия. Ако самата идея да не вярвате на това, което виждате, е подложена на атака, това е огромен проблем. Трябва да върнем истината в това, което виждаме".